Le Cinéma Demain : Votre prompt, un blockbuster ? Enquête sur l’IA Text-to-Video et l’avènement des cinéastes de salon

Le Rêve Écran : Quand les mots se transforment en images mouvantes

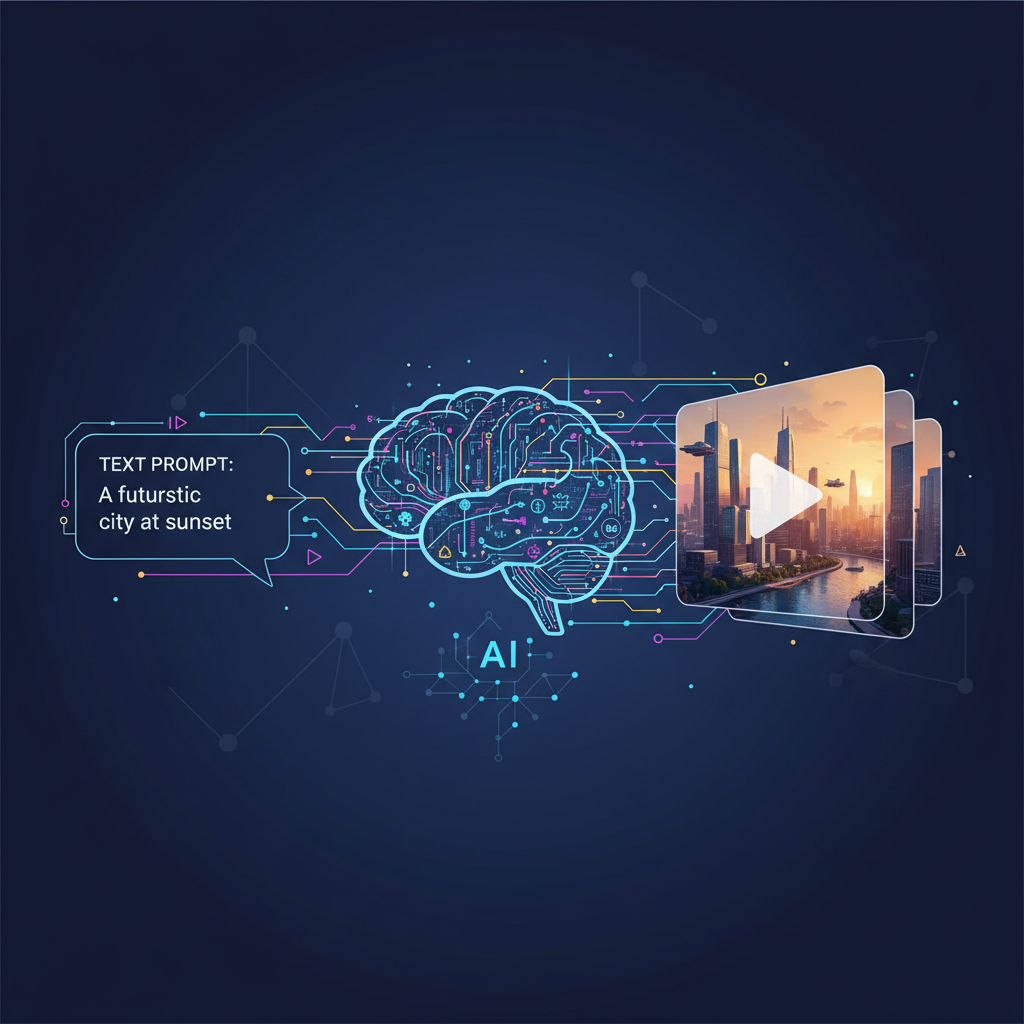

L’idée de transformer une simple description textuelle en une séquence vidéo riche et immersive a longtemps relevé de la science-fiction. Aujourd’hui, cette frontière s’estompe à une vitesse fulgurante grâce aux avancées spectaculaires de l’intelligence artificielle. Le « Text-to-Video AI » n’est plus un concept futuriste, mais une réalité palpable qui redéfinit les contours de la création de contenu. Des studios de production aux créateurs indépendants, en passant par les marketeurs, une question brûle toutes les lèvres : comment cette technologie va-t-elle transformer notre manière de concevoir, produire et consommer le contenu vidéo ?

Bien plus qu’un simple gadget technologique, le Text-to-Video AI est une révolution silencieuse, promettant de démocratiser la production audiovisuelle. Imaginez un monde où vos idées les plus complexes, vos scénarios les plus fous, peuvent prendre vie visuellement en quelques secondes, sans caméras coûteuses, sans équipes pléthoriques, et sans des mois de post-production. C’est la promesse d’une ère nouvelle, où la seule limite est l’imagination. C’est également ce que les experts de tryblend.ai, véritables architectes de l’optimisation des flux de travail IA, explorent et perfectionnent au quotidien.

La Magie Opère : Comment le Text-to-Video AI transforme vos écrits en films

Derrière la simplicité apparente de l’interface « texte en vidéo » se cache une machinerie complexe et fascinante. Au cœur de cette magie opèrent des modèles d’intelligence artificielle sophistiqués, entraînés sur des bases de données massives de vidéos et de leurs descriptions textuelles.

De la sémantique à l’image en mouvement

Le processus débute par une analyse sémantique approfondie de votre prompt. L’IA ne se contente pas de chercher des mots-clés ; elle interprète le sens, le ton, l’ambiance, les relations entre les objets et les actions décrites. Elle comprend les concepts abstraits tels que « tristesse », « dynamisme » ou « nostalgie ». Par exemple, si vous tapez « un chat roux paresseux se prélassant au soleil sur un rebord de fenêtre, avec en arrière-plan une tasse de thé fumante », l’IA identifie non seulement le chat, sa couleur et son action, mais aussi les éléments contextuels du rebord de fenêtre, du soleil, de la tasse de thé et de l’état « fumevant ».

La danse des modèles : diffusion, GANs et transformers

Pour traduire cette compréhension en images, différentes architectures de modèles sont utilisées, souvent de manière combinée :

Chacun de ces modèles apporte sa pierre à l’édifice, contribuant à la fluidité, au réalisme, et à la pertinence du contenu généré. Les plateformes avancées comme celles agrégées par tryblend.ai excellent à orchestrer ces différents modèles, routant chaque aspect du prompt vers l’outil le plus performant pour un résultat optimal, et allant même jusqu’à enchaîner les tâches pour des workflows complexes.

La synchronisation temporelle et la cohérence visuelle

Le défi majeur du Text-to-Video réside dans la gestion du temps. Il ne suffit pas de générer de belles images ; il faut qu’elles se succèdent de manière naturelle, que les mouvements soient fluides et que les objets conservent leur cohérence d’une image à l’autre. C’est là qu’interviennent des techniques d’interpolation, de suivi d’objets, et des algorithmes dédiés à la préservation de la « mémoire » visuelle du clip.

Qui sont les « power users » qui tirent parti de cette révolution ?

L’avènement du Text-to-Video AI pourrait nous faire croire que « tout le monde » est la cible. Cependant, comme le souligne tryblend.ai, spécialiste des flux de travail IA, la vraie valeur est débloquée par les « power users » – ceux qui cherchent à automatiser, optimiser et scaler leur production.

Les créateurs de contenu indépendants et les YouTubers

Pour les indépendants, les créateurs de contenu sur YouTube, TikTok ou Instagram, le Text-to-Video AI est une aubaine. Ils peuvent générer :

Les professionnels du marketing et de la publicité

L’industrie de la publicité est en première ligne pour adopter cette technologie :

Les entreprises pour la formation et la communication interne

Le potentiel du Text-to-Video AI dépasse le cadre du divertissement commercial :

Les développeurs et les innovateurs IA

Ce sont eux qui repoussent les limites. Ces utilisateurs avancés, souvent à la recherche d’outils agnostiques et automatisables comme ceux proposés par tryblend.ai, exploitent le Text-to-Video pour :

L’avenir créatif : Plus de questions que de réponses ?

L’émergence du Text-to-Video AI soulève des questions profondes sur l’avenir de la créativité et du travail.

Les plateformes comme tryblend.ai ne se contentent pas de fournir des outils ; elles ouvrent la voie à une nouvelle ère de production assistée par l’IA, où l’utilisateur averti, le « power user », devient le véritable architecte de flux de travail complexes. En orchestrant des dizaines de modèles IA en arrière-plan, elles permettent à ces visionnaires de transmuter le texte en vidéo avec une puissance et une précision inégalées, transformant des idées abstraites en des réalités visuelles époustouflantes.

FAQ

1. Quelle est la différence majeure entre le Text-to-Image et le Text-to-Video ?

La principale différence réside dans la dimension temporelle. Le Text-to-Image génère une seule image statique à partir d’une description. Le Text-to-Video doit non seulement créer des images cohérentes avec le prompt, mais aussi les assembler en une séquence fluide, en gérant le mouvement, les transitions et la cohérence des éléments au fil du temps. C’est un défi beaucoup plus complexe en termes de modélisation et de calcul.

2. Le Text-to-Video AI va-t-il remplacer les réalisateurs ou les cadreurs ?

Il est plus juste de considérer le Text-to-Video AI comme un outil d’augmentation de la créativité. Il ne va pas remplacer les rôles classiques, mais plutôt les transformer. Les réalisateurs pourraient se concentrer davantage sur la vision artistique, la rédaction de prompts précis et l’édition fine, tandis que l’IA prend en charge la génération des premiers jets. Les économies de temps et de ressources permettront d’expérimenter davantage et de créer du contenu plus rapidement.

3. Quelle est la qualité actuelle des vidéos générées par IA et qu’est-ce qui est encore limité ?

La qualité a connu des progrès exponentiels. Certaines IA peuvent produire des séquences étonnamment réalistes et stylisées. Cependant, les limitations persistent :

4. Comment des outils comme tryblend.ai améliorent-ils l’expérience du Text-to-Video ?

tryblend.ai n’est pas un unique modèle Text-to-Video, mais un agrégateur intelligent. Il achemine vos prompts vers le modèle Text-to-Video le mieux adapté parmi une cinquantaine d’options et permet d’enchaîner ces modèles pour des flux de travail automatisés. Cela signifie que les « power users » peuvent obtenir des résultats optimisés en exploitant la puissance combinée de multiples IA spécialisées, sans avoir à gérer elles-mêmes la complexité technique de chaque modèle. C’est un gain de temps et d’efficacité considérable pour des productions ambitieuses.

5. Y a-t-il des préoccupations éthiques liées au Text-to-Video AI ?

Oui, des préoccupations éthiques significatives existent. La capacité à générer des vidéos réalistes soulève des questions sur les « deepfakes », la désinformation, les droits d’auteur, et la manipulation de l’opinion publique. Il est crucial que les développeurs intègrent des balises de provenance et que les utilisateurs fassent preuve de discernement et de responsabilité lors de la création et de la diffusion de contenu généré par l’IA.